2026年4月20日,信息与智能工程学院杨明教授在书新3号楼305“人工智能数据与模型安全”专题学术讲座。本次讲座吸引了来自信息与智能工程学院、理工学院等多个院系的师生参与。讲座围绕AI安全基础、数据与模型安全攻击、防御方法以及未来挑战与趋势四大模块展开,系统梳理了人工智能安全领域的核心问题与前沿动态。

一、AI安全:从“助力安全”到“自身安全”的双重视角

讲座伊始,杨明教授以近年来一系列触目惊心的AI安全事件切入——微软聊天机器人Tay因数据投毒在24小时内发表大量歧视性言论被迫下线;针对自动驾驶汽车的对抗攻击导致车辆识别错误;深度伪造技术生成虚假视频引发社会信任危机;RealAI团队利用对抗样本设计的“眼镜”成功解锁多款安卓手机……这些案例直观地揭示了AI系统面临的真实威胁。

杨明教授指出,AI安全可以从两个核心视角理解:一是“AI助力安全”,即利用人工智能技术自动发现威胁,对系统进行攻击或防御;二是“AI自身安全”,即人工智能技术本身存在的漏洞和威胁。当前,随着大模型技术的爆发式发展,AI自身安全风险已成为学术界和工业界关注的焦点。

二、数据安全风险:从投毒到窃取,攻击手段日益多元

在数据安全层面,杨明教授详细介绍了数据投毒、隐私攻击、数据窃取以及篡改与伪造攻击等典型威胁。数据投毒是指在训练数据中注入恶意样本,干扰模型训练。常见形式包括标签投毒、特征投毒以及后门攻击。研究表明,即使训练数据中仅有0.01%的虚假文本,模型的有害输出率也会显著上升。

隐私攻击则试图从已训练的模型中逆向提取个人身份信息、敏感属性甚至原始训练样本。成员推断攻击利用模型对训练数据的“过拟合”特性,判断某个样本是否属于训练集;模型逆向攻击则能够重构出训练数据中的具体内容。杨明教授援引了Carlini等学者2023年的研究——Stable Diffusion等生成扩散模型存在严重的“记忆”问题,成功从模型中逆向恢复了604条训练文本,包括新闻报道、日志记录和私人通信信息。

数据窃取攻击通过诱导策略(如使用常见前缀、利用模型对稀有序列的高置信度输出)反复查询模型,从而窃取训练数据。篡改与伪造攻击则利用深度伪造技术生成高度逼真的虚假视频、图像,破坏信息的真实性。

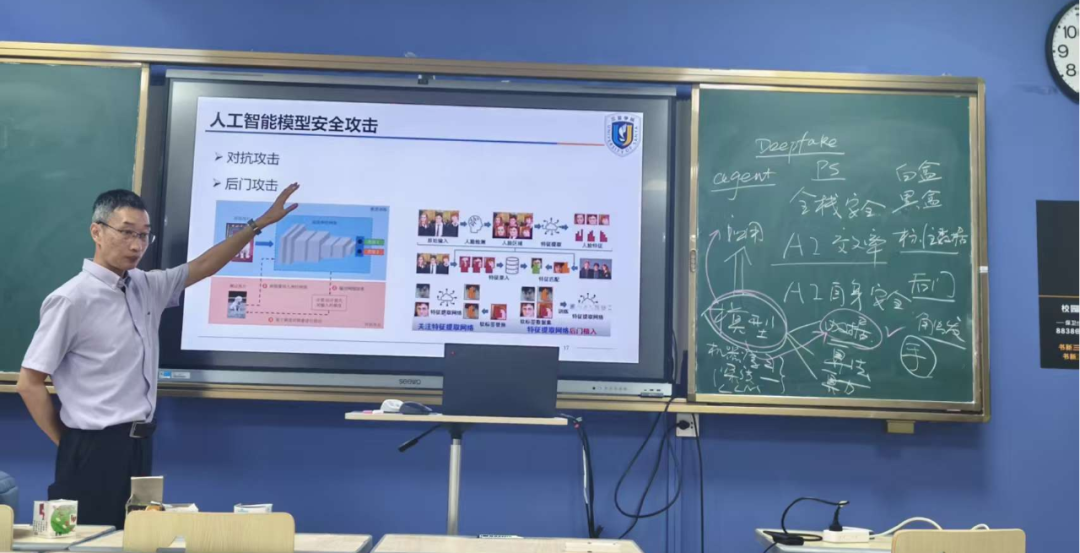

三、模型安全攻击:对抗攻击、后门攻击与模型窃取

在模型安全层面,杨明教授重点剖析了对抗攻击、后门攻击和模型窃取攻击的原理与分类。对抗攻击通过对输入数据施加微小且人类难以察觉的扰动,诱使模型产生错误预测。根据攻击者对模型信息的掌握程度,可分为白盒攻击、黑盒攻击和物理世界攻击。对抗攻击对医疗诊断、自动驾驶等高风场险景构成严重威胁。

后门攻击则是在AI模型中植入“逻辑木马”。攻击者设计一个“触发器”,并将带有触发器的恶意样本混入训练数据,使模型学习到恶意关联。模型在标准测试中表现正常,只有当攻击者输入包含触发器的样本时,模型才会执行预设的恶意行为。后门攻击按实现途径可分为全过程可控后门、模型修改后门和仅数据投毒后门;按攻击空间又可分为输入空间攻击、模型空间攻击、特征空间攻击等。

模型窃取攻击通过观察目标模型的行为或利用其输出,尝试复制或重建原始模型,从而获取其内部结构、参数或训练数据的近似信息。

四、防御方法:从差分隐私到对抗训练的多维防线

面对日益复杂的AI安全威胁,杨明教授系统介绍了当前主流的防御方法。

差分隐私通过在数据或查询结果中引入随机噪声,保护个体隐私。其核心思想是:无论某个个体的数据是否存在于数据集中,查询结果的分布几乎不变,从而阻止成员推断攻击。联邦学习实现了“数据不动、模型动”的分布式学习范式。数据保留在本地,模型在各参与方本地训练后,仅通过加密参数交换进行聚合,有效解决了数据孤岛和隐私泄露问题。

对抗样本检测训练一个二分类检测器,对输入进行“正常”与“对抗”的判别,是一种实用且直接的防御策略。对抗训练是目前提升模型鲁棒性最有效的方法之一。在训练过程中动态生成对抗样本并将其加入训练集,使模型学会抵御最坏情况下的输入扰动。此外,针对后门攻击,防御策略涵盖数据净化、统计异常检测、触发器逆向工程、联邦学习的鲁棒聚合以及行为监控等全周期手段。

五、未来挑战:从LLM到Agentic AI的安全范式转变

讲座最后,杨明教授将视野投向未来,提出了AI安全面临的若干重大挑战。大模型规模扩大带来了安全成本与漏洞放大的问题。多模态模型(图像+文本+语音联合)的新攻击面正在涌现。AI自主智能体的安全控制问题尤为突出——当AI从“动口”(内容生成)进化为“动手”(行动执行),能够深度集成办公系统、ERP、财务系统,一旦获得操作权限,攻击的后果就不再是信息泄露,而是可触及的物理损失。

杨明教授强调,从LLM到Agentic AI的演进,使失效模式从“不安全文本生成”转变为通过工具调用、持久化记忆和与不受信任的Web内容交互造成真实世界的损害。这对传统以内容安全为核心的治理体系提出了根本性质疑。他还指出,靠自我约束无法解决强人工智能的安全性问题。强人工智能的行为空间是无限的,而人们能够考虑的具体风险和约束手段是有限的。“以有限的约束去驯化具有无限可能性的强人工智能,是不可能没有漏洞的。”在治理层面,全球面临“科林格里奇困境”——过早过严可能扼杀创新,过晚过松则难以管控风险。各国治理路径呈现“监管偏好型”“发展优先型”“发展与安全平衡型”等差异化特征。而责任归属的核心痛点在于:当AI智能体自主决策导致损失时,责任应归属于提示词使用者、工具贡献者还是框架开发者?构建覆盖多主体的全链路责任共担框架,将是未来监管与技术共同面临的紧迫课题。

本次讲座内容丰富、案例翔实,既有技术深度,又具前瞻视野。杨明教授以生动的语言和严密的逻辑,为师生们呈现了一幅完整的AI安全知识图谱。在互动环节,同学们就大模型隐私保护、联邦学习实际部署等

话题与杨明教授进行了热烈讨论。后续,学院将持续关注人工智能安全前沿,推动相关课程建设与科研合作,培养具备安全意识与技术创新能力的高素质人才,为构建可信、可靠的人工智能生态贡献力量。

一审一校 | 杨 明

二审二校 | 杨 涛

三审三校 | 李成名 尹 娜